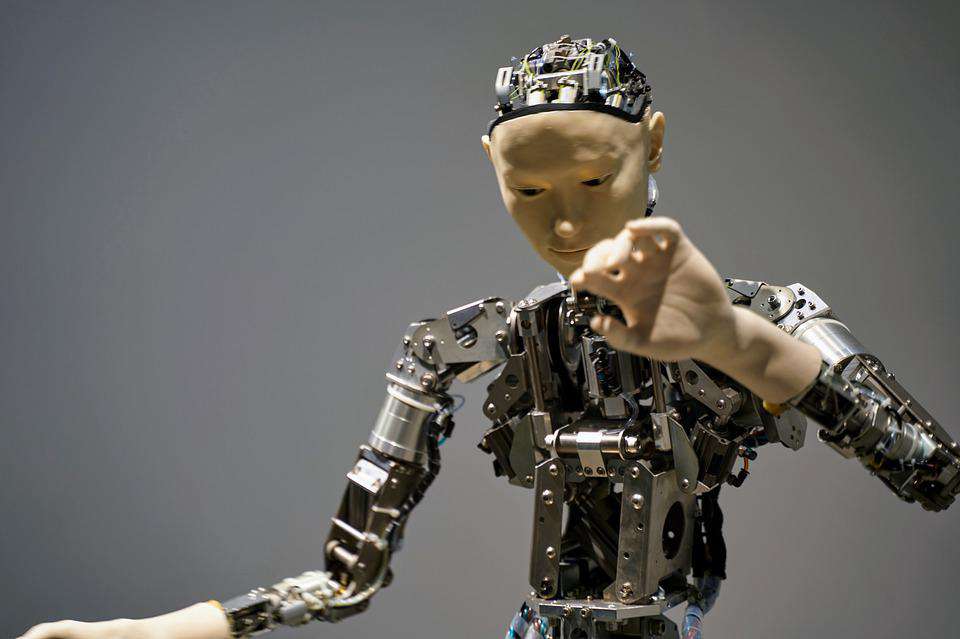

Искусственный интеллект имеет право на ошибку. Так, побывав в Твиттере, ИИ стал расистом. ИИ может ошибиться при поимке преступника. Неправильно поставить диагноз. Дезинформировать новостную службу. Поэтому ученые задумались, как сделать ИИ сознательным. И организовали AIRL - Лабораторию ответственности за действия искусственного интеллекта.

Между светом и тенью

В любых научных исследованиях наступает момент, когда ученые задумываются: “Не нарушает ли инновация моральных принципов?” Возьмем технологию видеонаблюдения. Система распознавания лиц на стадионе распознает преступника, который скрывается в толпе болельщиков. Но машина остается машиной, пусть и самой совершенной. А значит, может по ошибке обвинить невиновного. А если технология попадет в руки преступной организации, face recognition обеспечит травлю группы людей, допустим, по этническому принципу.

Другой пример. ИИ может заговорить голосом любого человека! И нейронные сети, приняв чей-то вид, позвонят по мессенджеру жертве, представятся родственником (а сходство будет безупречно) и срочно попросят денег?

Компании, внедряющие ИИ, должны защищать свою работу. Например, клиника обрабатывает тесты на COVID и доверяет ИИ большие данные. В таком случае, необходимо защищать сеть от хакерских атак, чтобы чья-то история болезни не попала хакерам. Важность сетевой безопасности подчеркивает в мануале и ExpressVPN: хакеры могут перехватить любую информацию, которая передается с устройства в сеть. И требуются инструменты, такие, как VPN, которые поместят данные в своеобразный туннель и обеспечат безопасность конфиденциальной информации.

Искусственному интеллекту не чужда этика?

Гендиректор AIRL Рамсей Браун объясняет суть проблемы:

- В сообществе, где разрабатывают ИИ, есть люди, работающие над соответствием стандартам. Но они не общаются с командами data science и не знакомы с реальными проблемами.

AIRL, наряду с организациями, которых беспокоит приватность, надеются изменить положение к лучшему. Сознательный ИИ нужен, чтобы технология учитывала интересы человека.

Предполагается, что сознательный ИИ оперирует четырьмя принципами:

- есть четкие критерии проверки, которые доказывают, что робота не взломать;

- цель и процесс принятия решений ИИ понятны любому пользователю;

- алгоритмы ИИ сами находят и устранят собственные неполадки;

- ИИ оперативно реагирует на изменения в IT-среде.