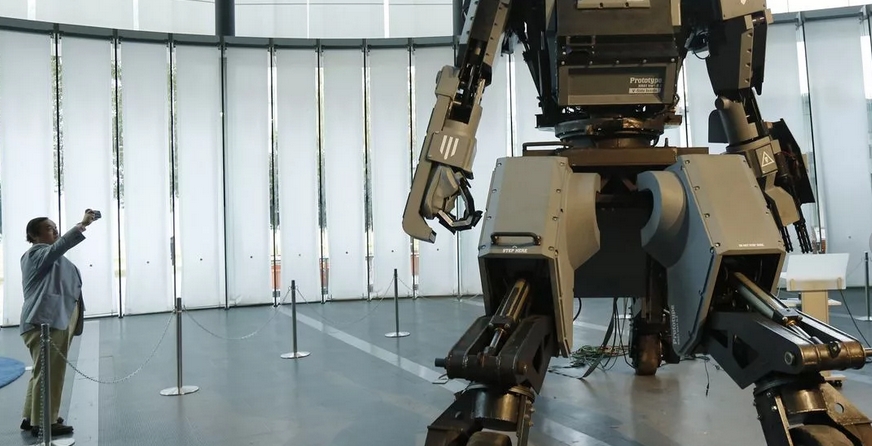

Фото с сайта postimees.ee

Эксперты из стран СНГ на конференции в Нур-Султане обсудили вопросы необходимости превентивного юридического запрета автономных систем оружия летального исхода (АСОЛД), передает корреспондент

Kazpravda.kz.Сегодня некоторые страны разрабатывают полостью автономное оружие, которое после активации сможет выбирать и поражать цели без дальнейшего участия человека. Это представляет собой серьезную проблему для защиты гражданского населения и соблюдения норм в области международного права в области прав человека и гуманитарного права.

"Разработка полностью автономного оружия поднимает множество моральных, этических, технических, правовых вопросов и вопросов безопасности. Позволить машинам принимать решения о жизни или смерти – значит пересечь фундаментальную моральную черту", – сказал директор Центра международной безопасности и политики Алимжан Ахметов.

По его словам, не имея человеческого суждения и способности понимать контекст, роботы не смогут принимать сложные этические решения на динамичном поле боя.

"Использование этих систем создаст пробел в подотчетности с неопределенностью относительно того, кто будет нести юридическую ответственность за действие робота: командир, программист, производитель или сам робот", – отметил Ахметов.

В свою очередь директор проекта по новым технологиям и международной безопасности ПИР-Центра (Россия) Вадим Козюлин также добавил, что нет четкого сформулированного термина АСОЛД, в чем будет заключаться запрет и человеческий контроль.

"Это сложные вещи. Если бы мы могли договориться о том, как контролировать, то мы достигли бы прогресса в этом вопросе. От того мы и обсуждаем эту тему с 2010 года. Поэтому, как говорится, с "какого боку ни возьмись - все выскальзывает из рук и выпадает". Необходимо обеспечить человеческий контроль, нужно запретить использование вооружения без человеческого контроля. Мы не говорим о запрете, а говорим о постоянном контроле со стороны человека. Скорее лучше говорить о человеческом контроле, чем о запрете, потому что запрет – это как запретить прогресс. Контроль может идти от оператора, командира или разработчика. К примеру, создали, инженер заложил свой алгоритм, и это уже его контроль. Это человеческий контроль. Два места, где можно контролировать – у производителя или у пользователя. Мне кажется, это более субстантивная вещь. Запрет же наложит большую трату денег и людей", – поделился Козюлин.

Заместитель директора Департамента многостороннего сотрудничества Министерства иностранных дел РК Арсен Омаров отметил, что искусственный интеллект предлагает обществу огромные возможности, но его можно обмануть, взломать или ввести в заблуждение.

"Казахстан активно принимал участие в Женеве по данной проблематике. В выступлениях казахстанская делегация подчеркивала, что опасность развития последствий новых технологий, которые всегда имеют двойное назначение, лучше переоценить, чем недооценить. Необходимо убедиться, что решения, принимаемые машиной, не подвержены постороннему влиянию и не могут быть изменены посредством кибер-атак. Нужно это учитывать, потому что АСОЛД, как и любые виды оружия, могут использовать террористы. Необходимо глубокое изучение данного вопроса в связи с тем, что даже беспилотное авто можно взломать и перепрограммировать, и оно будет как АСОЛД в какой-то форме. В этой связи необходимо введение какой-либо формы регулирования данной сферы", – предложил Омаров.

Напомним, что ранее появилась информация о том, что автономные роботизированные боевые системы, получившие грозное прозвище "роботы-убийцы", могут быть запрещены в Европе. С такой инициативой выступили Бельгия, Люксембург и Ирландия.

Кроме того, лауреат Нобелевской премии мира Джоди Уильямс призвал правительство Германии встать в авангарде кампании за запрещение «роботов-убийц». По мнению ученого, всего через три–четыре года боевые машины смогут работать в полностью автономном режиме и самостоятельно принимать решение об уничтожении целей.

Отметим, что на сегодня 28 стран активно выступают по превентивному запрету АСОЛД. В настоящее время на площадке ООН в рамках Конвенции о негуманном оружии сессионно работает Группа правительственных экспертов в целях выработки рекомендаций государствам-членам ООН по данному вопросу.